LinkedIn se enfrenta en Estados Unidos a una demanda por haber utilizado mensajes y datos privados obtenido en su red, de la que no debemos olvidar que es dueña Microsoft, para compartirlos con otras empresas con el fin de poder entrenar diferentes modelos de inteligencia artificial (IA). Se trata de un «permiso» que puede haber conseguido de manera poco transparente mediante una opción de privacidad que aparecía el pasado verano, y que permitía que terceros pudieran usar los datos privados depositados en la aplicación, que presume de ser la red profesional más grande del mundo.

La demanda se ha presentado en un tribunal federal de la localidad californiana de San José, y su texto denuncia que el nuevo ajuste de privacidad sobre el que los usuarios tenían que decidir el pasado verano llevaba de manera automática a los usuarios de la plataforma hasta un programa que permitía específicamente el uso de los datos y los mensajes que se compartían en la red para entrenar modelos de IA.

Esto es algo que ha ocurrido en Estados Unidos, donde el negocio de los datos de usuarios que hacen las empresas tecnológicas tiene muy pocos límites regulatorios, puesto que su legislación es mucho más laxa que la europea. Mediante el Reglamento General de Protección de Datos (RGPD), y ahora la Ley de Servicios Digitales, las plataformas tecnológicas y las redes sociales no pueden hacer lo que les dé la gana, y mucho menos obtener beneficios económicos vendiendo nuestros datos personales o interacciones en redes, o bien utilizarlos para entrenar modelos de inteligencia artificial.

se señala a Linkedin por haber tratado de esconder a posteriori esta irregular manera de obtener los permisos, al cambiar su política de privacidad y advertir a los usuarios de que se podía utilizar su información personal el entrenamiento de IAs

En EE.UU., los usuarios se defienden de estas prácticas en los tribunales y, por ejemplo, aferrándose a la Ley de Privacidad del Consumidor de California (CCPA) de 2018. Lógicamente, Microsoft se ve involucrada en esta demanda como subsidiaria y dueña de LinkedIn. La multinacional tiene grandes intereses e inversiones en modelos de IA, sin ir más lejos en Open AI, creadora de Chat GPT, así como en el desarrollo de su propia IA, Copilot, por lo que ante esta demanda está en el punto de mira.

Y más cuando se la señala por haber tratado de esconder a posteriori esta irregular manera de obtener los permisos, al cambiar su política de privacidad y advertir a los usuarios de que, a lo mejor, de una manera eventual, se podía utilizar su información personal el entrenamiento de IAs, cuando ya se había hecho y sin advertir en absoluto.

Antes de esto no había ninguna advertencia, porque LinkedIn, en su momento, cambió la sección de «preguntas frecuentes» o FAQ, en la que ya se advertía de que los usuarios podía elegir o no que sus datos se utilizaran para alimentar inteligencias artificiales, pero que si decían que no, daba igual, porque ese no permiso no iba a afectar a los entrenamientos que ya se hubieran realizado hasta entonces. Con esa afirmación querían curarse en salud, cubrir sus huellas, porque quedaba claro que, inicialmente, habían utilizado datos para los que no habían pedido consentimiento alguno.

LINKEDIN USÓ LOS DATOS Y PIDIÓ PERMISO DESPUÉS

En la demanda se señala que «las acciones de LinkedIn apuntan a que existe un patrón para intentar cubrir en todo momento sus huellas, comportamiento que sugiere que LinkedIn era perfectamente consciente de haber quebrantado sus obligaciones contractuales y estándares de privacidad y que trató de minimizar deliberadamente el escrutinio público derivado de su mala praxis», subraya la demanda colectiva.

Según explica la BBC en una publicación, con esa demanda se busca que la red social abone una cantidad de 1.000 dólares por cada usuario afectado por haber infringido la Ley de Comunicaciones Almacenadas y otra cantidad no especificada por incumplimientos de contrato y por vulnerar la ley de competencia de California.

El uso de datos para el entrenamiento de modelos de IA habría sido deshabilitado por LinkedIn en el Espacio Económico Europeo, Reino Unido y Suiza

El uso de datos para el entrenamiento de modelos de IA habría sido deshabilitado por LinkedIn en el Espacio Económico Europeo, Reino Unido y Suiza, según un email que la red social remitió a sus usuarios a finales del año pasado.

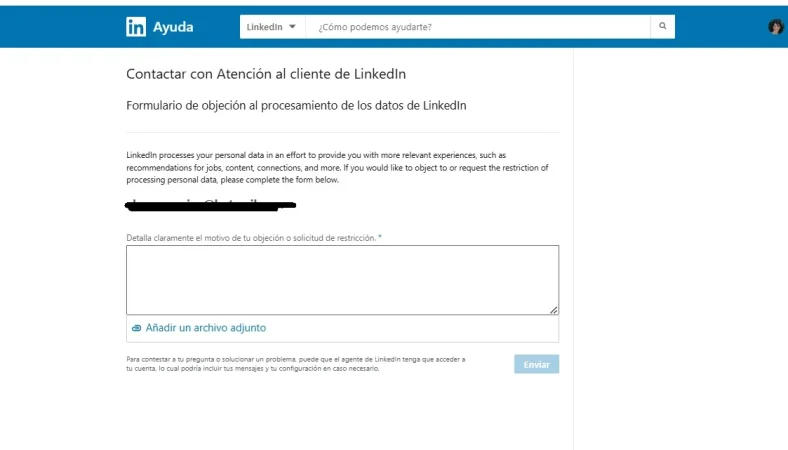

El mecanismo habilitado por la red profesional que permite impedir que la información de los usuarios se utilice pasa por pinchar en la pestaña «Ajustes y Privacidad» desde el menú desplegable ubicado debajo de la opción «Yo». Aparecerá una opción de configuración a la izquierda de la pantalla, donde se debe elegir «Privacidad de datos», y después el apartado «Datos para la IA generativa», que quedará marcada al desactivar el interruptor para restringir el acceso.

Así, quienes quieran evitar que su historial sea usado para perfeccionar las herramientas de IA de LinkedIn deberán llenar un «Formulario de objeción de procesamiento de datos», disponible en la página de ayuda de la red social.

Hay que tener en cuenta del enorme potencial y valor de la información que maneja la red social más grande en cuanto a relaciones laborales del mundo. Tiene más de 1.000 millones de usuarios en todo el mundo y en 2023 la plataforma ingresó en sus arcas 1.700 millones de dólares procedentes de las suscripciones premium a su sistema, que habrían sido las afectadas por la mala praxis de la filial de Microsoft.

linkedin tiene más de 1.000 millones de usuarios en todo el mundo y en 2023 la plataforma ingresó en sus arcas 1.700 millones de dólares procedentes de las suscripciones premium

El tema del uso de los datos y la privacidad también está creando controversia en EEUU desde la llegada de Trump al Gobierno de de Estados Unidos. El oro de los datos es codiciado. La Administración Trump ha solicitado recientemente a miembros demócratas de la Privacy and Civil Liberties Oversight Board (PCLOB) que renuncien a pertenecer al organismo, lo que le dejaría sin el quórum necesario y cuestionaría la independencia de otros mecanismos de supervisión en EE.UU.

La UE confía en organismos como el PCLOB para considerar que EE.UU. ofrece una protección «adecuada» de los datos personales. Sin embargo, su posible inoperatividad pone en riesgo la validez del Transatlantic Data Privacy Framework (TADPF), el marco regulatorio sobre privacidad de datos en EE.UU., y que podría afectar a miles de empresas y entidades europeas que dependen de proveedores en la nube estadounidenses, como Apple, Google, Microsoft o Amazon.

«Sin el TADPF, las organizaciones de la UE podrían verse obligadas a suspender el uso de servicios en la nube con proveedores de EE.UU., lo que tendría un impacto significativo en sus operaciones diarias y en la continuidad del negocio», explica el abogado experto en derecho digital Rodolfo Tesone Mendizabal, que precisamente ha publicado sus reflexiones en Linkedin.